Sara Lumbreras Sancho: «La inteligencia artificial puede predecir si un paciente necesitará UCI»

La subdirectora de Resultados de Investigación del Instituto de Investigación Tecnológica, experta en inteligencia artificial, subraya que todas las aplicaciones de la inteligencia artificial durante la pandemia que conoce se han hecho de forma respetuosa con la intimidad de las personas

Además de ser subdirectora de Resultados de Investigación del Instituto de Investigación Tecnológica e investigadora de la Cátedra de Ciencia, Tecnología y Religión, ambos de la Universidad Pontificia Comillas, Sara Lumbreras ha participado como experta en el seminario permanente La huella digital, ¿servidumbre o servicio?, organizado por la Fundación Pablo VI. Tras dos años de trabajo, el 24 de junio se presentaron sus conclusiones sobre la necesidad de poner la tecnología digital y el modelo económico de explotación de los datos al servicio del bien común. Ejemplo de ello son algunas de las investigaciones de esta ingeniera industrial durante la pandemia.

Quizá el ejemplo de nuevas tecnologías aplicadas a la pandemia que más familiar resulte a la gente son las aplicaciones de rastreo. ¿Qué papel juega en ellas la inteligencia artificial?

La mayoría de las aplicaciones no emplean inteligencia artificial, hay solo unos pocos casos. Por ejemplo, una aplicación India ha habido una que se complementaba con teoría de grafos y creaba un modelo muy simple de predicción. Si dos contagiados habían tenido contactos previos, aunque fuera antes de contagiarse, les avisaba porque a lo mejor tienen algún otro contacto común que pudiera ser la fuente del contagio. O si en esa ocasión había habido diez personas más, también las advertía por si acaso. Esa aplicación tenía acceso a más datos personales y podía almacenar las interacciones un tiempo mayor. Esos datos se supone que siempre están anonimizados, pero en muchos casos también se tuvo que aprobar una legislación de emergencia para permitirlo.

¿Por qué en unos lugares las aplicaciones han sido claves y en nuestro país su aportación parece casi nula?

Creo que han dado muy buen resultado en los países donde había un control férreo de la población. Se puede rastrear si lo haces con mucho cuidado, tienes toda la información y todo el mundo hace caso. El carácter exponencial de la epidemia implica que si se te escapa un mínimo porcentaje de contactos en seguida se escapa de tu control. En España tuvimos nuestra oportunidad pero no la aprovechamos, no se implementó una buena política de rastreo. Un punto negativo que tenía la aplicación Radar COVID era tener que estar reactivando constantemente que pudiera acceder al Bluetooth. Se basaba en él precisamente para evitar problemas de privacidad, pero la gente no estaba pendiente de conectarla todas las veces. El diseño podía haber sido mejor.

Menos conocido quizá es que medicamentos como el Remdisivir se propusieron como tratamiento gracias a la inteligencia artificial. ¿Cómo ocurren estos hallazgos?

Mediante una técnica llamada acoplamiento molecular puedes simular la espícula del coronavirus y ver con qué medicamentos ya existentes interactúa. Las proteínas, como la espícula, tienen una geometría muy compleja. En las simulaciones podemos ver si al chocar la espícula con las moléculas del medicamento se adhieren, lo que podría bloquear el virus. Es interesantísimo pero muy complicado. Requiere unos ordenadores muy potentes, y para simular una millonésima de segundo necesitas que el ordenador esté funcionando una semana. Es difícil y costoso. Aun así, en las empresas farmacéuticas se usa mucho para la selección de posibles medicamentos, entre los que ya existen. Luego hay que probarlos en ensayos clínicos reales, por supuesto; pero es más fácil probar cuatro ya seleccionados que 400.

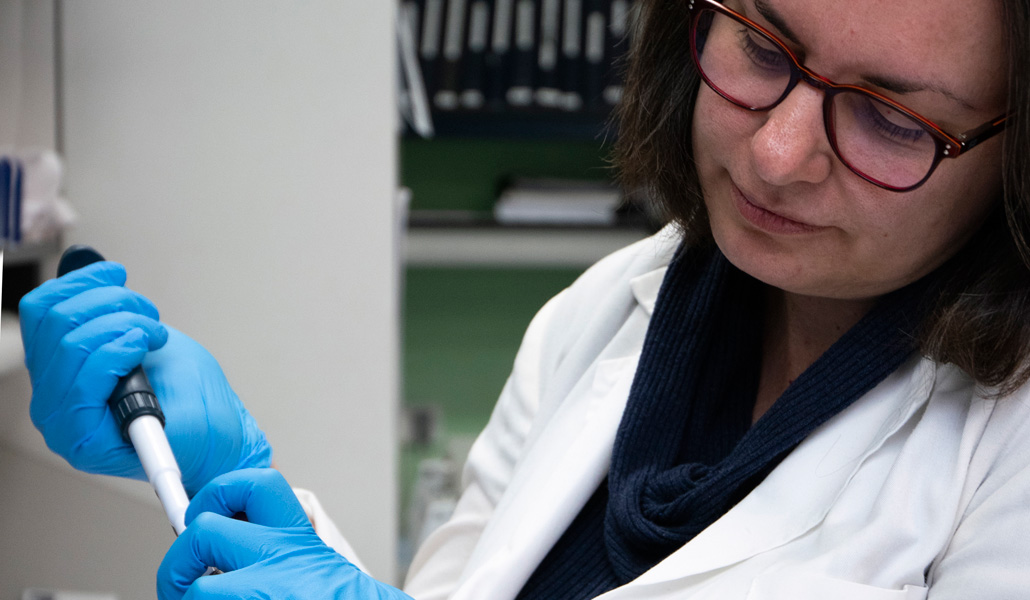

Otras aplicaciones de la inteligencia artificial han sido la ayuda en el diagnóstico y predecir la evolución de la enfermedad según los síntomas.

Hubo una explosión de artículos en ese sentido cuando no había disponibilidad de PCRs, pero bajó mucho el interés en cuanto estuvieron disponibles. Un ejemplo de este tipo de pruebas es el análisis de imágenes de tomografía del tórax. Podemos enseñarle a la máquina ejemplos de tomografías y etiquetarlas como coronavirus o no. La máquina puede extraer los patrones de esos datos, y luego puede identificarlos en otras imágenes.

Esta técnica se llama aprendizaje supervisado.

En cuanto a la evolución de la enfermedad, yo misma participé en un estudio sobre esto. Para planificar los recursos hospitalarios es clave estimar los enfermos van a necesitar UCI. Nosotros usamos todos los datos de la historia clínica de los enfermos de Castilla-La Mancha, como la edad o el índice de masa corporal, entre otros. Con ellos e inteligencia artificial diseñamos un árbol que predecía quién iba a tener esta necesidad basándose en factores fáciles de medir. Vimos que los factores con más valor predictivo eran una frecuencia respiratoria superior a 20 veces por minuto, algunos ruidos respiratorios, la edad y la fiebre. Acertaba en tres de cada cuatro casos aproximadamente. Además, el resultado es fácil de usar. No hace falta que el médico tenga la máquina de inteligencia artificial, les puedes dar este árbol o mapa y que lo utilicen para apoyar su decisión (que al final siempre es y debe ser suya).

¿Se ha aprovechado todo este potencial?

Clarísimamente se podría haber hecho más. Tengo una sensación mixta. Por un lado, la inteligencia artificial y la ciencia en general han demostrado que hay mucha gente dispuesta a trabajar duro cuando se necesita y se puede avanzar muy rápido. Nuestro estudio lo hicimos gracias a la entrega total de todo el mundo en noches y vacaciones. Pero por otro lado se ha evidenciado que no es lo mismo poder hacer que saber hacer, y tampoco saber hacer que realmente hacer. La implementación es difícil y nunca podemos dar la victoria por supuesta.

¿Por falta de voluntad política, de recursos, o porque simplemente no es lo mismo la vida real que el laboratorio?

Hubo fallos políticos. También de gestión. Por ejemplo, conozco a un equipo que muy pronto diseñó un respirador, lo probaron en su laboratorio y hicieron los planos para que quien tuviera una impresora en 3D pudiera imprimirlos. Pero nunca se utilizaron porque no estaban homologados. Creo que, en un momento en el que la gente se estaba muriendo, se tendrían que haber utilizado. No había nada que perder. Por otro lado, hay que contar también con que las personas y las instituciones no son perfectas y deben realizar un ejercicio de reflexión y aprendizaje para poder mejorar.

En muchos casos, la inteligencia artificial funciona detectando patrones en la relación entre unos datos previos y un resultado final, pero sin razonamiento o explicación. ¿Esto se puede considerar conocimiento? ¿Es fiable?

Nos hallamos inmersos en un momento el que nuestra teoría del conocimiento está evolucionando. Cuando utilizo mis herramientas de inteligencia artificial, lo que obtengo son correlaciones, pero no relaciones causales. Hay muchos que aún confunden una cosa con la otra, lo cual es un engaño. Pero también otros que, en un empeño por ser puristas, rechazan los resultados pensando que son inútiles. No, espere usted. Tenemos que emplear todos los datos disponibles para intentar aumentar el conocimiento disponible. Y tendremos que usar los métodos existentes y crear otros nuevos para, a partir de esas correlaciones que sugieren relaciones, ver dónde existen relaciones causales y dónde no. Ahí vamos a necesitar al ser humano. Nuestro estudio sobre la UCI, por ejemplo, se desarrolló con médicos y desde los médicos. No hay otra manera. Por ejemplo, las herramientas te pueden dar resultados que funcionen bien estadísticamente pero no tengan sentido.

¿Por ejemplo?

Hubo un estudio reciente en el que parecía que el riesgo de sufrir un evento cardiovascular disminuía con la edad. Eso no puede ser. Al estudiarlo desde un punto de vista clínico, se ve que lo que sucede es que da mucho peso a la hipertensión, y lo que te está diciendo el modelo es que si tienes hipertensión ya siendo joven es mucho peor. Hay que desentrañar la verdad clínica detrás de lo que está diciendo el modelo. Habrá veces que no desvele nada nuevo porque esté en consonancia con el conocimiento previo que tengamos. Pero otras puede apuntar a vínculos que no han aparecido antes. Se ha visto, por ejemplo, que la presencia de la bacteria responsable de la gingivitis tiene una correlación enorme con el alzhéimer. Cuando ves que realmente los datos no te mienten, que no se equivocan por tener pocos datos o que estén sesgados, solo te cabe empezar a estudiarlo y buscar una teoría sobre a qué puede deberse. La máquina no te va a solucionar eso, pero sí entra en ese primer momento del proceso de generación de hipótesis. Y también al final, para comprobar tus conclusiones.

En plena crisis, sobre todo en los primeros meses en los que los hospitales estaban colapsados, ¿no era un obstáculo la obtención de datos completos, que son la base de la inteligencia artificial?

España es (o en el momento de nuestro estudio lo era) el país con más penetración de la historia clínica electrónica del mundo. Colaboramos con una empresa española que se llama Savana y son líderes en gestión de estas historias, y con unos médicos maravillosos, los doctores Ancochea, Izquierdo y Soriano, que fueron los que tuvieron la idea. Pedimos a los hospitales utilizar las historias clínicas electrónicas. De ellas podemos extraer los datos directamente y anonimizarlos o pseudonimizarlos, con mucha seguridad para garantizar la confidencialidad. Con las herramientas de Savana el proceso es rápido y de ahí se acaba derivando una base de datos enorme con todos los datos codificados.

En esos terribles primeros meses, ¿con herramientas así se podría haber gestionado mejor la información sobre las muertes? ¿Y, después, predecir antes las segundas y terceras olas?

La inteligencia artificial descansa sobre la hipótesis de que los datos sean correctos, y en este caso aquí ha habido un problema. Muchas veces los datos eran difíciles de obtener. En otras, más que a lo que se ha hecho dentro de los hospitales se ha debido a una toma de decisiones a nivel político o de comunicación. En algunos momentos se informaba con más detalle, luego con menos, ha habido muchas correcciones…

En cuanto a la posibilidad de predecir o detectar precozmente las olas, es más difícil de lo que parece. La realidad siempre te sorprende, y suele ser a peor. Y, además, las decisiones de gestión tienen muchísimo impacto porque la inteligencia artificial aprende con datos del pasado, y si cambian los datos o las reglas del juego tu predicción no sirve. Personalmente, en enero de 2020 yo empecé a introducir los datos que tenía en un sistema, y mi resultado era que nos íbamos a quedar sin respiradores en junio. La inteligencia artificial nos ayuda en un entorno conocido, con una cierta estabilidad. En la primera ola, por ejemplo, estábamos muy pendientes de la R, el número reproductivo básico, que representa a cuántas personas contagia cada contagiado. Pero eso es solo un componente pequeño. Hay otro parámetro que mide cómo están de concentrados los contagios. Un virus puede tener una R baja pero que un supercontagiador contagie a 20 personas, y eso impacta muchísimo. La gente que había trabajado en epidemias lo sabía, pero se hizo un esfuerzo por sobresimplificar.

Todos estos desarrollos, ¿han sido respetuosos con la intimidad de las personas?

En todos los que yo he participado o sobre los que he leído, desde luego.

¿El auge de los preprint o publicaciones científicas no revisadas por pares por la situación de emergencia ha afectado a la calidad de la investigación?

Sí, claro. Se ha publicado muchísimo, pero también muchísimo de baja calidad. De todas maneras, en una situación de emergencia me parece más importante avanzar deprisa que seguir todos los filtros y ser muy puristas. Un proceso de revisión por pares rápido puede durar dos meses, pero en otras situaciones tarda dos años. Y en un caso así lo que tienes que hacer en cuanto tienes algo es publicarlo. Incluso si es poco más que una corazonada, como que a los pacientes tratados con corticoides porque son asmáticos parece que les va mejor. Si publicas eso en un repositorio de acceso libre, la gente lo puede leer, comprobarlo en sus pacientes, y así poder llegar a conclusiones probadas avanzando avanzamos juntos más rápido.

Siendo conscientes de sus limitaciones, estos recursos parecen útiles.

Van a ser cada vez más importantes. Creo que en ciencia tenemos que cambiar el modelo de publicación. Está claro que está en crisis. No tengo tan claro cómo vamos a poder equilibrar todo, porque también se quiere tener publicaciones que hayan pasado un proceso de revisión y los académicos necesitamos publicar en revistas de prestigio. Las editoriales están viendo que tienen que cambiar. Cobran cada vez más importancia las revistas de acceso abierto, en las que es el autor el que paga por publicar y los resultados se difunden libremente; y hay otras maneras de difundir los resultados de manera gratuita. Resulta muy interesante, y hasta dentro de unos años no sabremos cómo queda el panorama.

Además de que la inteligencia artificial haya contribuido a solucionar problemas en este año y medio, ¿la pandemia ha servido además para que la propia inteligencia artificial haya mejorado? ¿Se han hecho nuevos descubrimientos o se han abierto nuevos horizontes?

Se ha producido un reconocimiento de técnicas que ya tenemos, y se ha comprobado que las podemos aplicar rápidamente. También ha habido aprendizajes. El principal en mi caso ha sido en este ámbito de los modelos de inteligencia artificial interpretable, aunque para mí ya venía siendo importante. Normalmente, la gente en inteligencia artificial funciona con cajas negras, como las redes neuronales: con unos datos te da un resultado, y si te lo crees lo implementas y si no, no. Clínicamente esto no es aceptable. Necesitas saber por qué. El árbol sobre los ingresos en UCI de nuestro estudio sí te deja ver los factores que tiene en cuenta y las decisiones que está tomando, para comprobar que tienen sentido. Ahí la inteligencia artificial está en el diseño. En vez de ajustar miles de capas de una red neuronal, la utilizas para, junto con el clínico, ajustar cuáles son las preguntas que haces en cada rama y cómo las intercalas, de manera que sea comprensible para un humano. Esta es la inteligencia artificial que realmente nos puede ayudar a tomar decisiones, porque la idea es que cuando hay mucho en juego (como en el sector de la salud), la máquina no decide si no que ayuda al humano a decidir.