¿Tienen implicación las plataformas en la proliferación de los mensajes de odio?

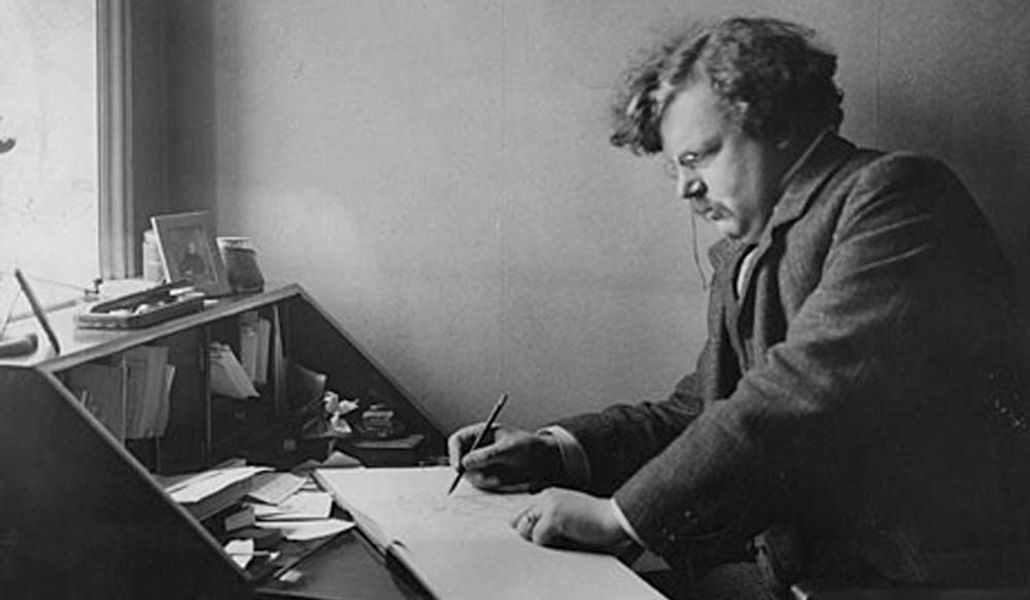

«Las plataformas no crean el odio, pero sí diseñan los entornos en los que ese contenido circula y se viraliza», advierte José Gabriel García, Garz, CEO de Agencia Phi y experto en estrategia digital.

—¿Hasta qué punto los algoritmos contribuyen a amplificar mensajes de odio y polarización?

—Los algoritmos no quieren amplificar el odio, pero sí están diseñados para priorizar el contenido que genera más interacción. Y sabemos que los mensajes emocionales, extremos o polarizantes suelen provocar más reacciones, comentarios y compartidos que los contenidos moderados. Eso hace que, en la práctica, el sistema tienda a premiar ese tipo de publicaciones. No es necesariamente una decisión ideológica, sino una consecuencia del modelo de negocio basado en la atención: cuanto más tiempo pasan los usuarios interactuando, más valor tiene la plataforma. El problema es que ese diseño puede acabar amplificando dinámicas de confrontación o discursos de odio si no existen mecanismos de corrección.

—¿Qué implicación tienen las plataformas en la proliferación de los mensajes de odio?

—Las plataformas no crean el odio, pero sí diseñan los entornos en los que ese contenido circula y se viraliza. Su responsabilidad está en tres niveles: en cómo funcionan sus algoritmos de recomendación, en qué normas de moderación aplican y en la rapidez y coherencia con la que actúan cuando se vulneran. Durante años el crecimiento y la escala han sido la prioridad, y la moderación siempre ha ido un paso por detrás. Hoy existe más conciencia y más herramientas, pero todavía hay un debate pendiente sobre hasta qué punto las plataformas deben asumir un rol más activo en la gestión de los contenidos tóxicos sin convertirse en árbitros del debate público.

—¿Cómo funcionará HODIO? ¿Puede ser una herramienta eficaz para actuar contra los discursos de odio?

—Por lo que se ha adelantado, HODIO pretende medir de forma sistemática la presencia y evolución del discurso de odio en redes sociales, analizando cómo se difunden ciertos mensajes y generando indicadores públicos sobre su alcance. Ese enfoque puede ser útil porque, hasta ahora, gran parte del debate se ha basado en percepciones o en estudios parciales. Tener datos comparables y transparentes puede ayudar a entender mejor qué está ocurriendo, qué plataformas están reaccionando y cuáles no. Ahora bien, la eficacia dependerá de la metodología, de la transparencia del sistema y de que se utilice como una herramienta de diagnóstico y rendición de cuentas, no solo como un instrumento político o comunicativo.

—¿Hay riesgo de utilización ideológica? Que solo sea considerado odio lo que afecte a una determinada ideología y no al resto de ideologías o entidades…

—Ese riesgo siempre existe cuando hablamos de conceptos que pueden interpretarse de forma distinta según el contexto. Por eso es clave que cualquier sistema de medición tenga criterios claros, metodologías abiertas y supervisión independiente. El discurso de odio debe definirse con estándares lo más objetivos posible y aplicarse de forma transversal, independientemente de quién sea el emisor o el destinatario. Si la percepción pública es que se utiliza para señalar solo a determinados actores o ideologías, la herramienta perderá credibilidad y eficacia.

—¿El bien tiene cabida en las redes sociales?

—Sí, sin duda. Las redes sociales también han demostrado su capacidad para movilizar solidaridad, difundir conocimiento o crear comunidades positivas. El problema es que el contenido constructivo suele ser menos viral que el conflictivo, porque las emociones negativas activan más la reacción inmediata. Esto no significa que el “bien” no tenga espacio, sino que necesita otras dinámicas: comunidades fuertes, liderazgo de voces responsables y plataformas que incentiven también los contenidos que generan conversación saludable. El reto no es eliminar el conflicto, que forma parte del debate público, sino evitar que el ecosistema digital premie sistemáticamente lo más tóxico.